J’ai longuement hésité avant d’écrire ce texte. Ma position est inconfortable. Je dirige depuis vingt ans une entreprise dont l’activité consiste à déployer chez nos clients les technologies que je m’apprête ici à mettre en cause. Mais le malaise vient peut-être de là, justement : si nous, qui vivons à l’intérieur du système, ne parlons pas honnêtement de ce qui se passe, qui le fera ?

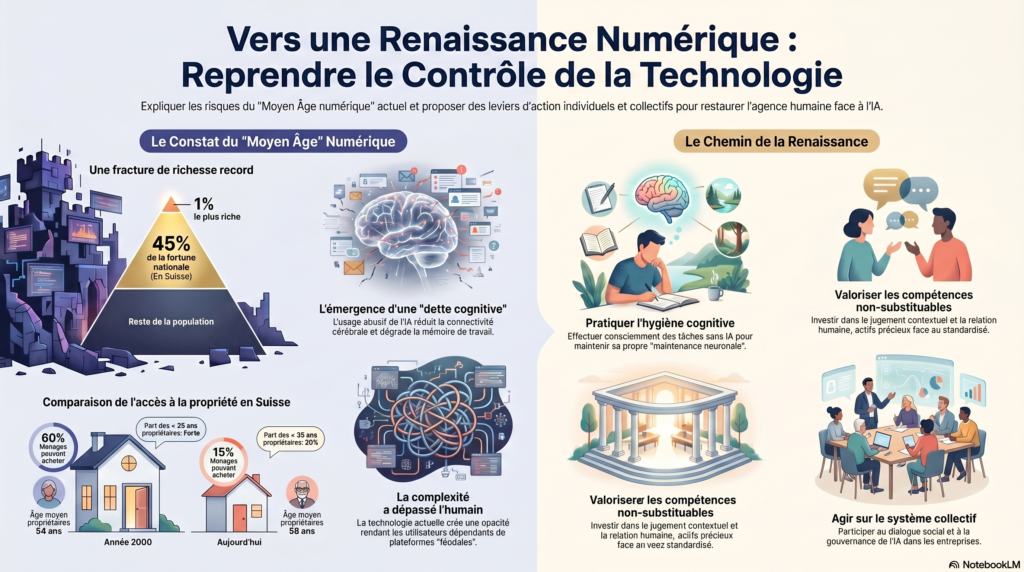

Le constat est dur, et je préfère le poser sans détour. Nous traversons une sorte de moyen âge numérique. La globalisation, les réseaux sociaux et l’intelligence artificielle générative ont produit en deux décennies une opacité et une dépendance dont nous percevons mal l’étendue. James Bridle, dans New Dark Age, parle d’une obscurité spécifique : la complexité technologique a dépassé la compréhension humaine. Yanis Varoufakis parle de techno-féodalisme : les plateformes seraient devenues des fiefs, leurs utilisateurs des serfs numériques. Quelle que soit la métaphore retenue, l’intuition qu’une dégradation s’est produite dans notre rapport au monde technique est aujourd’hui largement partagée, y compris parmi ceux qui, comme moi, travaillent à faire fonctionner les outils en question.

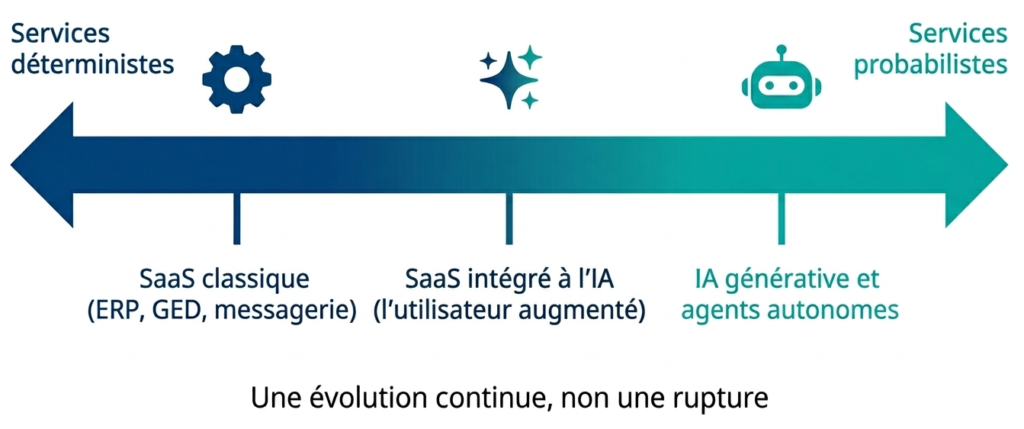

L’analogie de la révolution industrielle

L’analogie qui revient le plus souvent, dans les conférences comme dans les écoles, est celle de la révolution industrielle. Elle est juste et c’est précisément pour cela qu’elle devrait nous donner à réfléchir.

La révolution industrielle a effectivement produit des gains de productivité considérables. Mais ces gains ont mis soixante ans à se traduire en hausse des salaires réels. Les historiens économiques appellent cette période la pause d’Engels. Entre 1780 et 1840, le PIB britannique a crû de 46% pendant que les salaires des ouvriers ne progressaient que de 12%. L’espérance de vie en Angleterre a stagné entre 1820 et 1870 (cinquante ans, au pic de la révolution) à cause de l’urbanisation rapide, des conditions de travail, des eaux contaminées. Les enfants travaillaient douze à seize heures par jour dans des manufactures. La richesse créée a été extraordinaire ; sa distribution, obscène.

La douleur du changement n’est jamais répartie équitablement. Ce ne fut pas le cas pendant la révolution industrielle, et il n’y a aucune raison de penser que ce le sera durant notre révolution numérique. Les premiers chiffres confirment cette inquiétude et la Suisse n’y échappe pas. Il y a vingt ans, près de 60% des ménages suisses pouvaient acquérir un logement de prix médian ; aujourd’hui, cette proportion est tombée à 15%, soit 660 000 ménages (selon UBS). L’âge moyen des propriétaires immobiliers est passé de 54 ans en 2000 à 58 ans aujourd’hui ; seuls 20% des ménages de moins de 35 ans accèdent à la propriété, contre 55% des seniors de 70 ans. Dans l’arc lémanique, il faut désormais plus du double du revenu médian d’un jeune ménage, soit environ 18’500 CHF par mois, pour acquérir un logement. La concentration de la fortune, elle aussi, a fortement augmenté : le 1% le plus riche détient aujourd’hui 45% de la fortune nationale, contre environ un tiers en 1980. Et selon une étude récente de l’Université de Zurich, 19 des 26 cantons suisses affichent désormais des écarts de patrimoine plus marqués que les États-Unis. Pendant ce temps, la classe moyenne suisse s’érode et les CEO des grandes plateformes deviennent les humains les plus riches de l’histoire enregistrée. Le prix Nobel d’économie 2024, Daron Acemoglu, estime d’ailleurs que les gains de productivité réels de l’IA seront probablement plus modestes que ne le claironnent les cabinets de conseil. Mais que les gains soient massifs ou modestes, la question centrale reste la même : qui les capturera ?

La renaissance est possible, elle n’est pas garantie

Pourtant, je reste optimiste. Et je veux expliquer pourquoi, sans dissimuler les conditions de cet optimisme.

Après le moyen âge est venue la Renaissance. Après la révolution industrielle sont venues, péniblement, les lois sur le travail, les syndicats, l’éducation publique, les premières protections sociales. À chaque fois, après la phase de douleur, des sociétés ont réussi à reconstruire des institutions qui ont redistribué une partie des gains et restauré un certain équilibre humain. Cela ne s’est pas fait par magie. Cela ne s’est pas fait sans conflit. Mais cela s’est fait.

Aujourd’hui, je perçois plusieurs signaux qui suggèrent qu’une renaissance pourrait être en route. Le mouvement du digital minimalism, popularisé par le chercheur Cal Newport, gagne du terrain. Particulièrement, et c’est intéressant, chez les générations qui ont grandi avec les écrans : retour aux téléphones simples, livres physiques, expériences hors-ligne. Le marché de l’artisanat connaît une croissance robuste. Les grandes maisons de luxe, jusqu’à Hermès et Porsche, reviennent à des illustrations dessinées à la main pour leurs campagnes, parce que le contenu généré par IA déclenche une fatigue mesurable chez le consommateur. Un article récent du New York Times, signé par Isabel Cristo, documente l’émergence d’une nouvelle norme : buy better, buy less : acheter moins mais mieux, valoriser la provenance humaine. Les recherches en psychologie expérimentale convergent sur un fait curieux : une œuvre identique est jugée plus belle, plus significative et plus précieuse quand les lecteurs croient qu’un humain l’a faite… même quand l’IA a créé la version « humaine ».

Ce sont des signaux. Ce n’est pas une certitude. La renaissance n’est pas un déterminisme historique ; c’est une possibilité qui dépend de choix : individuels, organisationnels, politiques.

L’outil est le propre de l’homme

Au cœur de cette renaissance possible, je crois qu’il y a une question philosophique simple, qu’il faut poser sans détour : que faisons-nous, nous humains, de cette nouvelle classe d’outils ?

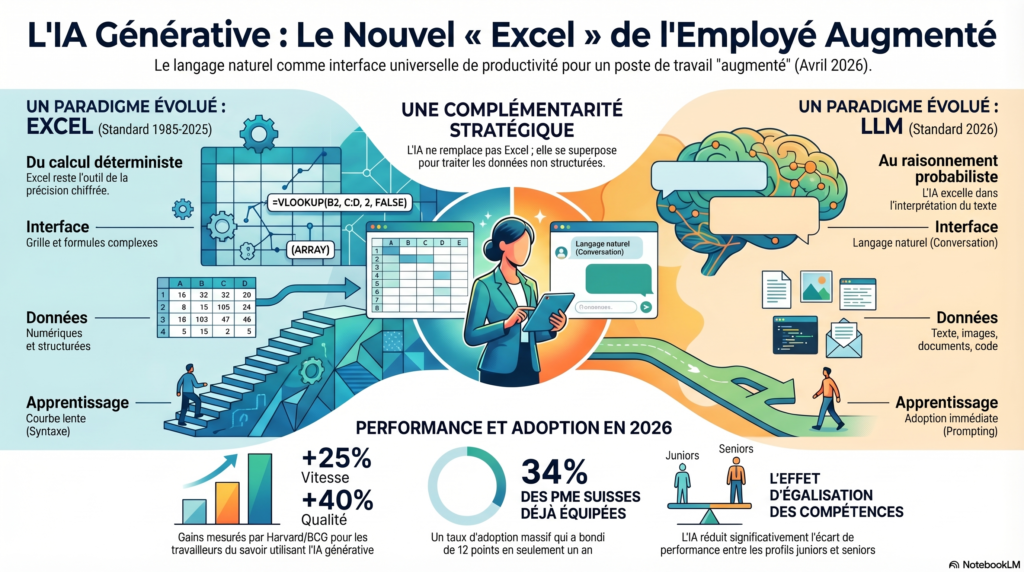

Henri Bergson écrivait que l’humain est homo faber, l’homme qui fabrique des outils. L’outil est le propre de l’homme. Le silex taillé, la roue, la presse à imprimer, le moteur à vapeur, l’ordinateur : chacun a augmenté nos capacités et transformé nos sociétés. L’intelligence artificielle générative entre dans cette lignée. Elle est un outil, un outil considérable. Mais un outil n’est pas un substitut. Une pioche démultiplie la force du bras, elle ne creuse pas à votre place. Une calculatrice exécute des opérations, elle ne décide pas ce qu’il faut calculer.

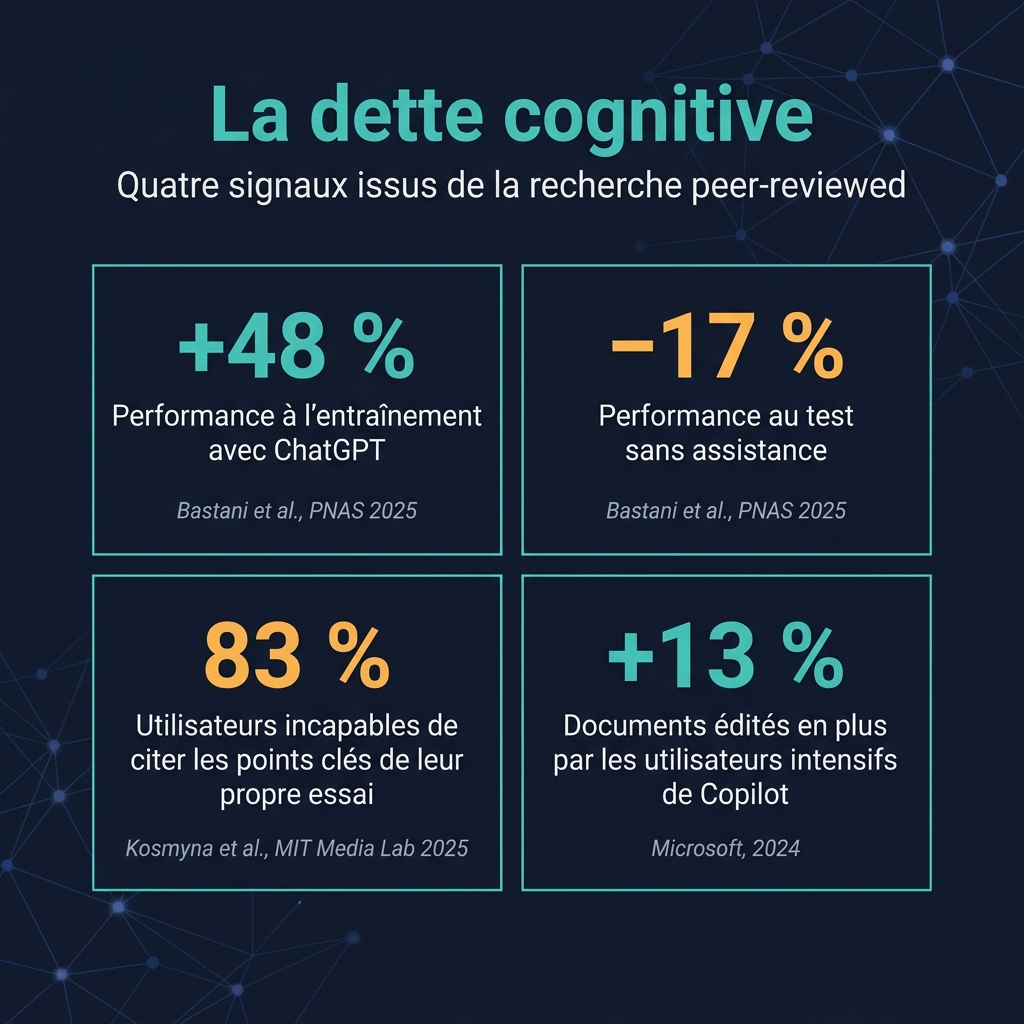

Le risque spécifique de l’IA générative est qu’elle peut donner l’illusion de penser à notre place. Une étude récente du MIT Media Lab, conduite par Nataliya Kosmyna et son équipe, a mesuré par électro-encéphalographie la connectivité cérébrale d’étudiants rédigeant des essais avec ou sans assistance IA. Les utilisateurs réguliers de ChatGPT présentaient une connectivité significativement plus faible, une mémoire dégradée, et, détail troublant, étaient incapables de citer correctement leurs propres essais quelques minutes après les avoir écrits. Les auteurs parlent de dette cognitive. C’est une étude préliminaire, qui demande réplication. Mais elle pose une question qu’il serait imprudent d’éluder.

L’enjeu, pour chacun de nous, est de garder l’outil à sa place : devant nous, comme un instrument que nous mobilisons consciemment, et non au-dessus de nous, comme une présence qui nous décharge progressivement de la nécessité de penser. L’humanité authentique, créative, attentive, capable de surprise et d’erreur signifiante, ne relève pas de la nostalgie. Elle est l’attribut qui résistera à la commoditisation des contenus standardisés.

Ce qui ne dépend pas de nous

Il y a beaucoup de choses, dans ce paysage, sur lesquelles nous n’avons aucune emprise. Je l’observe autour de moi, chez des collègues comme chez des amis : beaucoup s’épuisent à suivre en continu le flux de l’actualité, économique, politique, technologique, climatique, dans une veille devenue obsessionnelle. Cette posture a un coût. Elle produit de l’anxiété sans produire d’action. Sénèque, dans ses Lettres à Lucilius, le formulait déjà il y a deux mille ans : « on souffre plus souvent en imagination qu’en réalité ».

L’évolution des modèles d’IA ne nous appartient pas. Les capacités progresseront indépendamment de notre opinion. La stratégie des géants technologiques ne nous appartient pas non plus. Les feuilles de route d’OpenAI, Anthropic, Meta et Google se déploieront avec ou sans nous. Le rythme du changement structurel, la pause d’Engels numérique, ou ce qui en tiendra lieu, ne nous appartient pas. La question de savoir si tel ou tel métier sera substituable à dix ans ne nous appartient pas pleinement non plus.

S’épuiser sur ces sujets ne change rien à leur évolution. La sagesse pratique, ici, vient d’une intuition très ancienne. Épictète, au premier siècle de notre ère, écrivait dans son manuel : « Il y a des choses qui dépendent de nous, et d’autres qui n’en dépendent pas ». Pour les premières, agir avec énergie. Pour les secondes, accepter avec sérénité. Cette dichotomie a deux mille ans : elle reste pertinente.

Ce qui dépend de nous

Voici donc ce qui dépend de nous. Je parle ici aux employés des entreprises suisses romandes qui partagent une certaine philosophie de proximité, de relation humaine et de qualité longue. Quatre propositions concrètes.

L’hygiène cognitive personnelle. Préserver vos compétences fondamentales ! Lire un texte long sans assistance, écrire un premier jet sans IA, faire un raisonnement à voix haute devant un collègue, calculer mentalement, ne relève pas de la nostalgie. Il s’agit de maintenance neuronale documentée par la littérature récente. Avant chaque sollicitation de l’IA, posez-vous la question : cette tâche est-elle de nature à faire travailler mon cerveau, ou seulement à le décharger d’une corvée sans valeur cognitive ? Si c’est la première, l’IA dégrade. Si c’est la seconde, l’IA libère. Cette règle simple change tout.

L’usage intentionnel de l’IA dans votre métier. Cal Newport, dans Digital Minimalism, formule un principe : chaque usage d’une technologie doit relever d’un choix conscient, pas d’une habitude. Concrètement cela signifie : ne pas démarrer la journée par ChatGPT ; ne pas laisser l’IA produire le brouillon de vos décisions importantes ; vérifier systématiquement ce que produit l’IA avant de le transmettre, même quand cette vérification est ennuyeuse ; garder par ailleurs des plages de travail sans aucune assistance. L’enjeu n’est pas idéologique. Vous devez rester capable de défendre ce que vous signez.

L’investissement dans les compétences non substituables. La littérature économique converge sur un point : l’IA est forte sur les tâches codifiables, faible sur le jugement contextuel, la décision sous incertitude, la relation humaine de qualité, la coordination d’équipes complexes. Ces compétences sont aussi celles que l’expérience accumule lentement et que la formation continue peut renforcer. Pour vous, employé, cela oriente le choix de vos projets, de votre carrière : préférez les missions où vous arbitrez, négociez, comprenez un contexte client, intégrez des contraintes implicites, plutôt que celles où vous produisez du contenu standardisé qui sera, à terme, généré automatiquement.

L’hygiène attentionnelle et le capital humain authentique. Notifications désactivées, applications de focus, plages sans écran, lecture profonde régulière, activités non-numériques : musique, sport, jardinage, marche… Ce n’est pas une posture esthétique. Vos relations professionnelles, votre signature personnelle, votre voix, votre style sont des actifs qui prennent de la valeur à mesure que le contenu IA inonde le marché. Plus le standardisé devient abondant, plus le singulier devient précieux.

La zone d’influence partielle

Il y a une zone intermédiaire que je dois mentionner, parce qu’elle compte particulièrement en Suisse. La philosophie stoïcienne classique distingue ce qui dépend de nous et ce qui n’en dépend pas. Le philosophe contemporain William Irvine raffine cette dichotomie en y ajoutant une troisième catégorie : ce sur quoi nous avons une influence partielle.

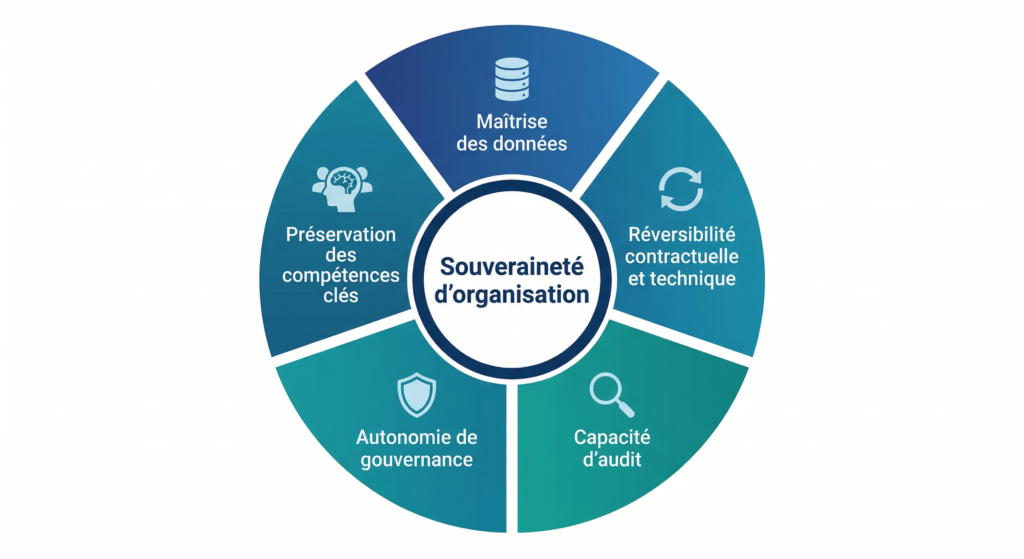

Dans cette catégorie, plusieurs choses méritent votre attention. La culture de votre équipe face à l’IA : vous ne décidez pas seul, mais vous l’influencez par vos propositions argumentées et vos démonstrations d’alternatives concrètes. L’évolution des outils utilisés dans votre métier : vous pouvez peser sur les choix par des retours d’expérience documentés et des comparaisons honnêtes. La trajectoire de votre carrière : vous ne maîtrisez pas le marché, mais vous orientez votre formation et votre positionnement professionnel. Enfin, la réputation de votre employeur comme acteur responsable de l’IA : vous y contribuez par vos signalements internes et votre participation aux discussions de gouvernance.

Sur ces sujets, l’attitude la plus juste consiste à investir notre énergie dans l’effort sans nous attacher au résultat. Agir intensément sur la qualité de nos contributions, accepter sereinement que la décision finale appartienne à d’autres.

La renaissance ne sera pas seulement individuelle

Je voudrais conclure sur un point qui me tient à cœur. Les leviers individuels que je viens d’évoquer comptent. Mais la renaissance dont je parlais au début ne se produira pas par la simple addition des disciplines personnelles.

Si la révolution industrielle a fini par bénéficier à une grande partie de la population, ce n’est pas parce que chaque ouvrier a cultivé ses vertus individuelles. C’est parce que des syndicats se sont organisés, des lois sur le travail ont été votées, l’école obligatoire a été instituée, des protections sociales ont été construites. Cela a pris des décennies. Cela s’est fait contre des résistances considérables.

La renaissance numérique demandera l’équivalent. À notre échelle, cela veut dire : participer aux discussions sur l’IA dans son entreprise plutôt que laisser les décisions importantes se prendre uniquement entre direction et fournisseurs ; soutenir et exiger des dispositifs de formation continue qui aillent au-delà du simple prompt engineering ; participer au débat public suisse sur la souveraineté numérique, la protection des données, la régulation de l’IA ; appuyer un dialogue social qui traite enfin sérieusement la question de la place de l’IA dans nos métiers. La tradition suisse (et européenne) du dialogue social est forte : elle a beaucoup à offrir, et beaucoup à construire, dans le contexte numérique.

Aux dirigeants qui me liront, et il y en aura, car nous travaillons dans le même tissu, quatre messages brefs. Un employé qui pratique un usage intentionnel des outils numériques préserve ce qui fait la valeur durable de sa contribution : sa capacité de jugement et son ownership cognitif sur ce qu’il signe ; la dette cognitive a un coût caché qu’aucun gain de productivité immédiat ne compense. Les programmes de formation à l’IA gagnent en conséquence à développer cette discipline d’usage plutôt qu’à courir après les taux d’adoption. Maintenir des zones « humain protégé » dans l’organisation, où la contribution humaine est explicitement requise, est cohérent avec la prime au human-made qui se dessine sur le marché. Enfin, la réputation de l’entreprise comme employeur capable de tenir la promesse de l’humain augmenté, celle d’un collaborateur dont les outils renforcent l’intelligence sans la remplacer, deviendra, j’en suis convaincu, un actif RH décisif. Cette promesse, encore largement programmatique aujourd’hui, attend ses pionniers.

Nous sommes au moyen âge numérique. La renaissance, elle, dépendra de ce que nous ferons, séparément, et ensemble.

Pour aller plus loin

- Acemoglu, D. (2024). The Simple Macroeconomics of AI. NBER Working Paper 32487. https://www.nber.org/papers/w32487

- Allen, R. C. (2009). Engels’ Pause: Technical Change, Capital Accumulation, and Inequality in the British Industrial Revolution. Explorations in Economic History, 46(4), 418-435.

- Bergson, H. (1907). L’Évolution créatrice. Paris : Félix Alcan. Édition de référence : PUF, édition critique par F. Worms et A. François, 2007 (chapitre II).

- Bridle, J. (2018). New Dark Age: Technology and the End of the Future. Verso.

- Cristo, I. (2025). Buy Better, Buy Less, Feel Smug About It. The New York Times, 7 décembre 2025. https://www.nytimes.com/2025/12/07/opinion/fashion-quality-ethical-consumption.html

- Épictète. Manuel, §1.

- Irvine, W. B. (2008). A Guide to the Good Life: The Ancient Art of Stoic Joy. Oxford University Press.

- Kosmyna, N. et al. (2025). Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task. MIT Media Lab. arXiv:2506.08872. https://arxiv.org/abs/2506.08872

- Martínez, I. Z., Marti, S. & Scheuer, F. (2025). L’influence des impôts sur la fortune sur la répartition de la fortune dans les cantons suisses, 1969-2018. Social Change Switzerland. https://www.socialchangeswitzerland.ch/?p=4269

- Newport, C. (2019). Digital Minimalism: Choosing a Focused Life in a Noisy World. Portfolio.

- Sénèque. Lettres à Lucilius (Epistulae morales ad Lucilium), lettre XIII, §4.

- UBS Chief Investment Office GWM (2024). Real Estate Focus 2024 — Étude annuelle du marché immobilier suisse. https://www.ubs.com/global/fr/media/display-page-ndp/fr-20240411-real-estate-focus-2024.html

- Varoufakis, Y. (2023). Technofeudalism: What Killed Capitalism. Bodley Head.